說到要運行 AI 語言模型,絕大多數的人都會認為電腦規格不能太差,事實上不一定,隨著技術越來越成熟,現在即使是超級老的電腦,也能跑 AI 語言模型,最近就有國外團隊做到這一點,在 26 年前老電腦運行 llama98.c 語言模型,而且回應速度還不錯。

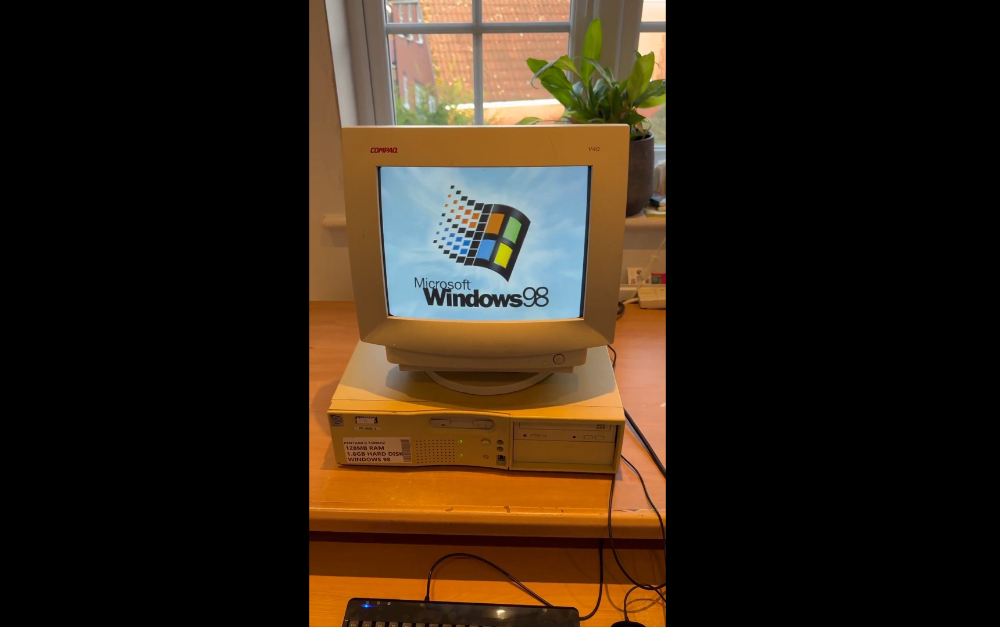

26 年前的超老電腦能跑 AI 語言模型

最近國外 EXO Labs 在部落格中詳細分享如何在 26 年前的 Windows 98 老電腦上運行 Llama 語言模型。

根據介紹,他們是由牛津大學的研究人員和工程師組成,使命是「讓 AI 資源普及化」,希望建立開放的基礎設施來訓練前沿模型,讓任何人都能在任何地方運行這些模型。而透過這次實驗,也展現就算是一般人,也能在任何設備上訓練和運行 AI 模型。

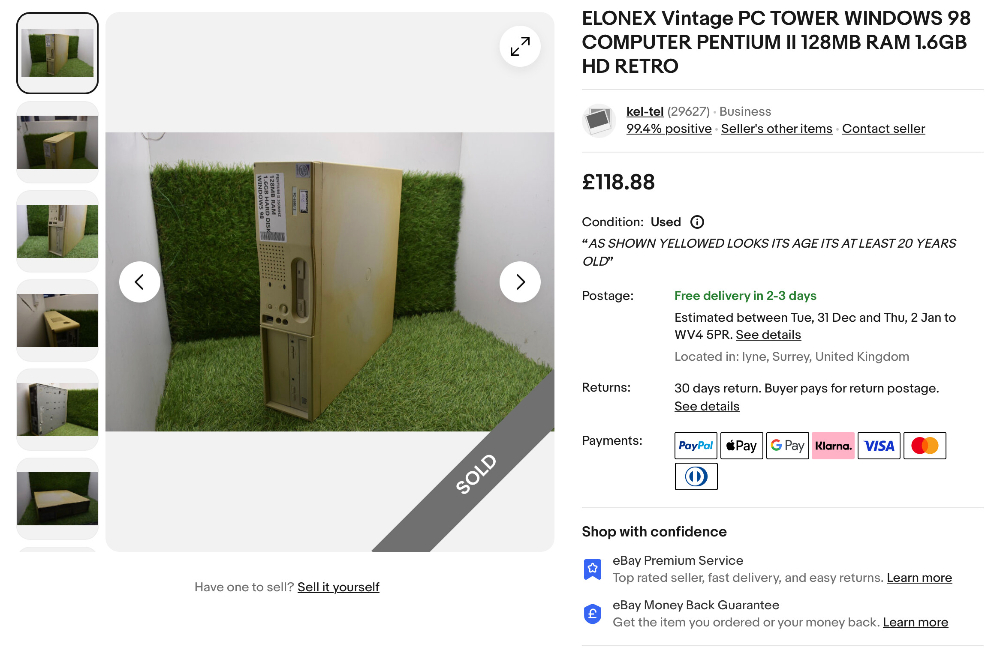

不過他們沒有一台這麼老的電腦,是從 eBay 入手一台 Windows 98 Pentium II,價格其實也不便宜,要 118.88 英鎊,約台幣 5,000 元:

另外也因為這台電腦實在太老,跟現代許多外接設備都不兼容,像是 USB 鍵盤和滑鼠,必須使用以前的 PS/2 連接介面,而且滑鼠必須插入端口 1,鍵盤插入端口 2,反過來是沒辦法正常運行:

可以正常操作後還有另一個挑戰:如何將模型放進到電腦裡。

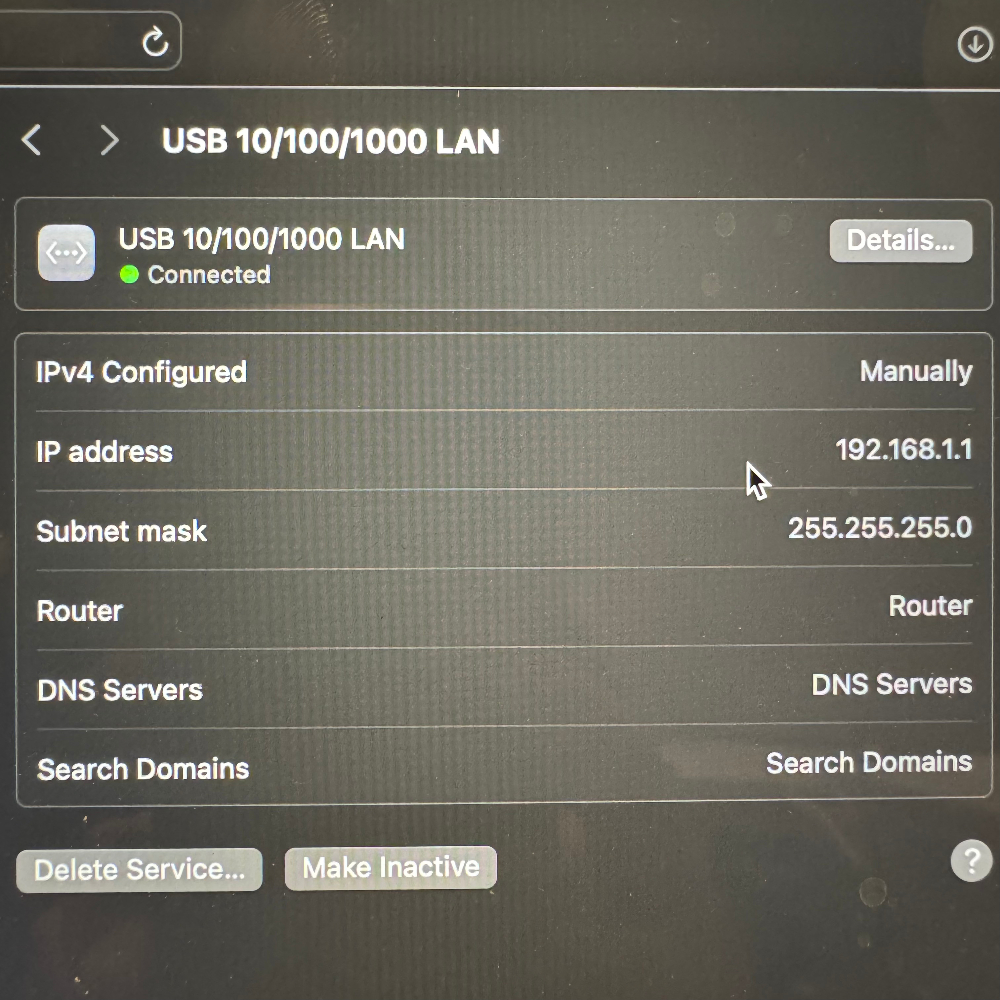

他們嘗試過系統無法正常識別 RW,4TB 硬碟對 FAT32 來說也太大,最後不得不使用「老式的 FTP」方式,藉由乙太網端口進行文件傳輸:

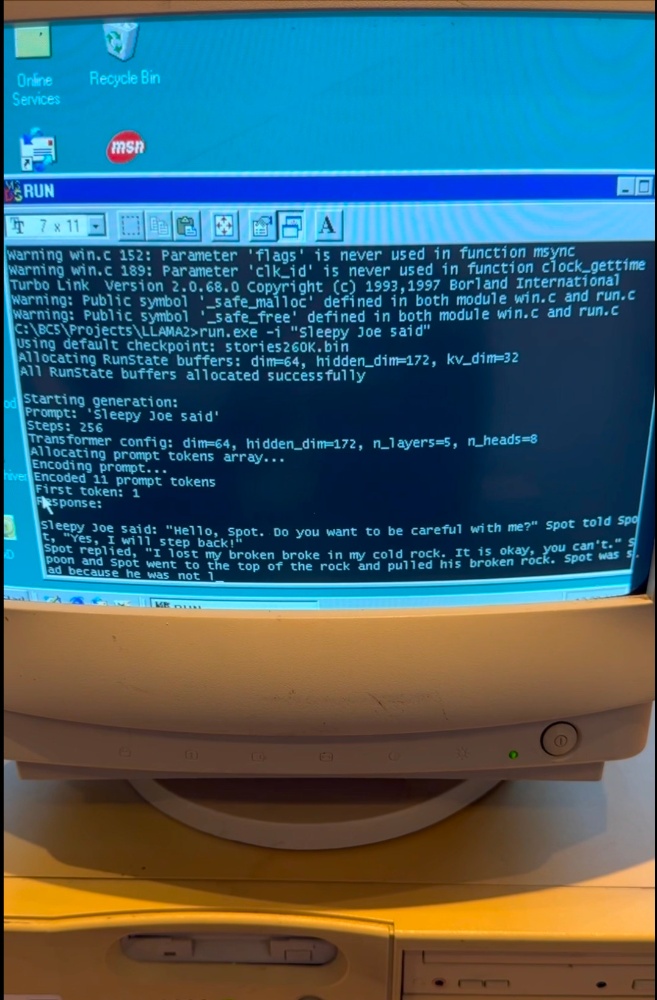

EXO 提到,Windows 98 編譯現代程式碼是非常棘手的問題,最後找到了 Andrej Karpathy 的 llama2.c,這是一個 700 行純 C 程式碼,能在 Llama 2 架構的模型上進行推理。藉由這個資源,以及舊版的 Borland C++ 5.02 IDE 和編譯器(加上一些小的調整),就能夠製作成與 Windows 98 兼容的可執行文件並運行(原始程式碼可在這找到:GitHub):

他們也錄製一部短片,從影片中可以看到,這台 Pentium II 老電腦開機後進入 Windows 98 作業系統,啟動基於 Andrej Karpathy 的 Llama2.c 的自定義純 C 推理引擎,並要求 LLM 生成關於 Sleepy Joe 的故事,令人驚豔的部分是回應速度很不錯:

LLM running on Windows 98 PC

26 year old hardware with Intel Pentium II CPU and 128MB RAM.

Uses llama98.c, our custom pure C inference engine based on @karpathy llama2.c

Code and DIY guide 👇 pic.twitter.com/pktC8hhvva

— EXO Labs (@exolabs) December 28, 2024

當然,這個語言模型比較小,只有 260K,這也是為什麼這麼老的電腦,又沒 GPU 顯卡也能運行的原因之一。

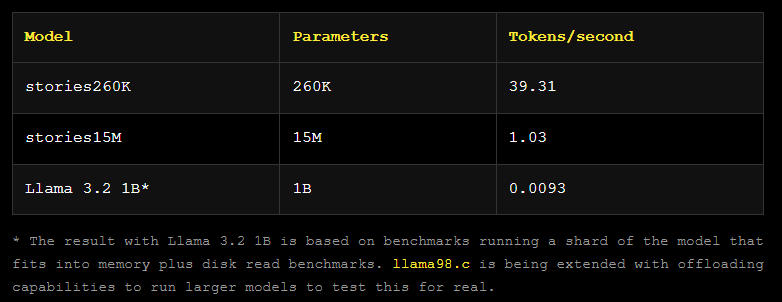

EXO 有分享測試數據,260K 擁有 39.31 tok/sec 的速度,但 LLM 提升到 15M 後,生成速度會降到 1.03 tok/sec,Llama 3.2 1B 就很慢,只有 0.0093 tok/sec:

EXO 也承認,這速度不完全是 ChatGPT 的水平,但能在 25 年前的 CPU 硬體上運行任何現代 AI 模型,對他們的使命來說仍然是邁出了一大步。

如果你想要了解更多,可以閱讀 EXO 的部落格文章。