現在越來越多研究讓照片開口說話的 AI 人工智慧生成軟體,今天為大家介紹字節跳動和美國德克薩斯州大學達拉斯分校合作研發的「DREAM-Talk」,DREAM-Talk 能用單一張照片生成逼真、帶有情感、能說話的面部動畫。不管甚麼情感 DREAM-Talk 都能夠表達出來,表情也可以隨著講話的內容發生改變。 DREAM-Talk 更是支援多國語言,中文、日文、法文、德文都不在話下。

字節跳動研發用單一張照片就能生成逼真、帶有情感、能說話的面部動畫「DREAM-Talk」

由跨國網際網路技術公司字節跳動和美國德克薩斯州大學達拉斯分校合作研發基於擴散的情感驅動語音方式來生成能說話的逼真面部動畫「DREAM-Talk」,DREAM-Talk 的創作框架以音檔、一個初始狀態、情感風格作為關鍵輸入數據。由可調節強度的情感文檔轉語音的 EmoDiff 模型來調整音檔。使用初始狀態來做為第一幀中的表情。情格風格則是與音檔無關的隨機選取的表情片段。

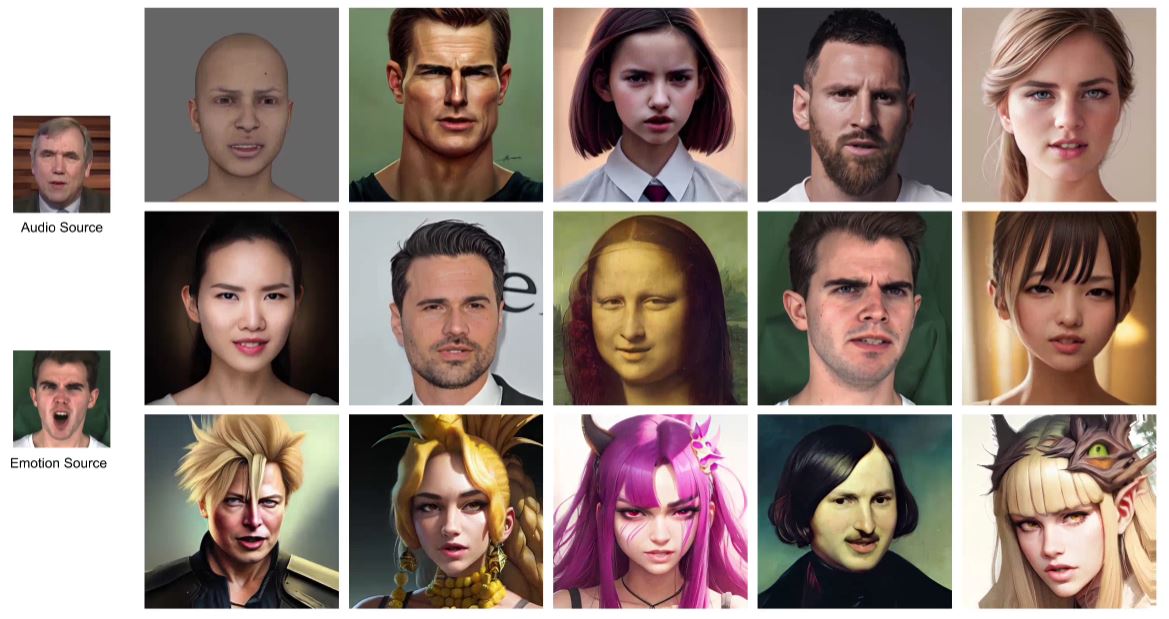

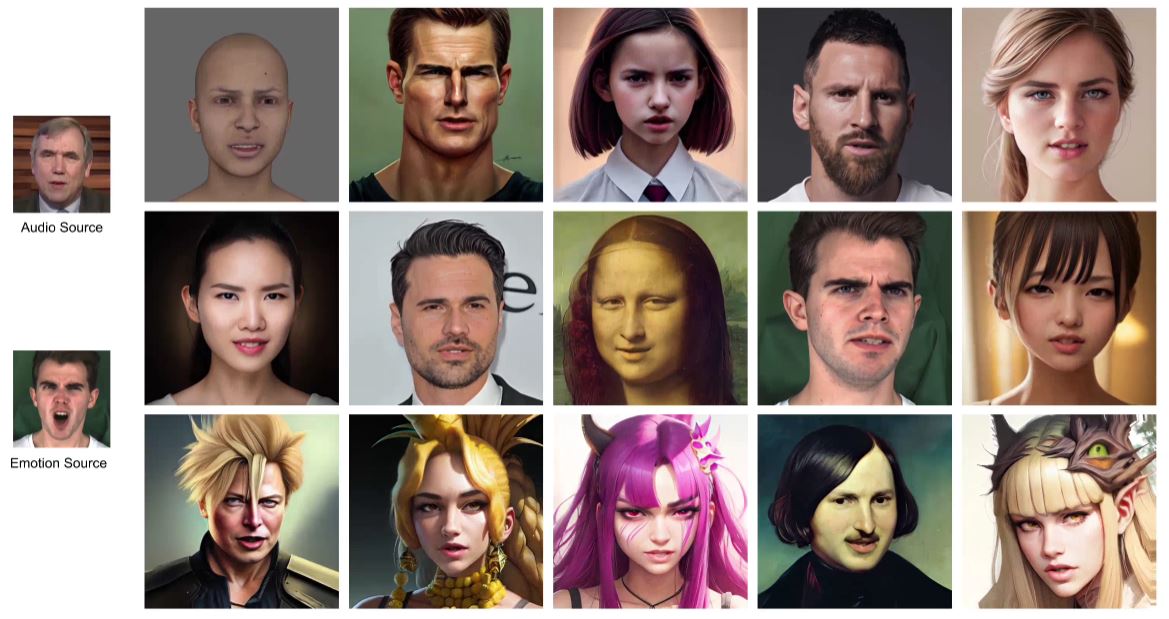

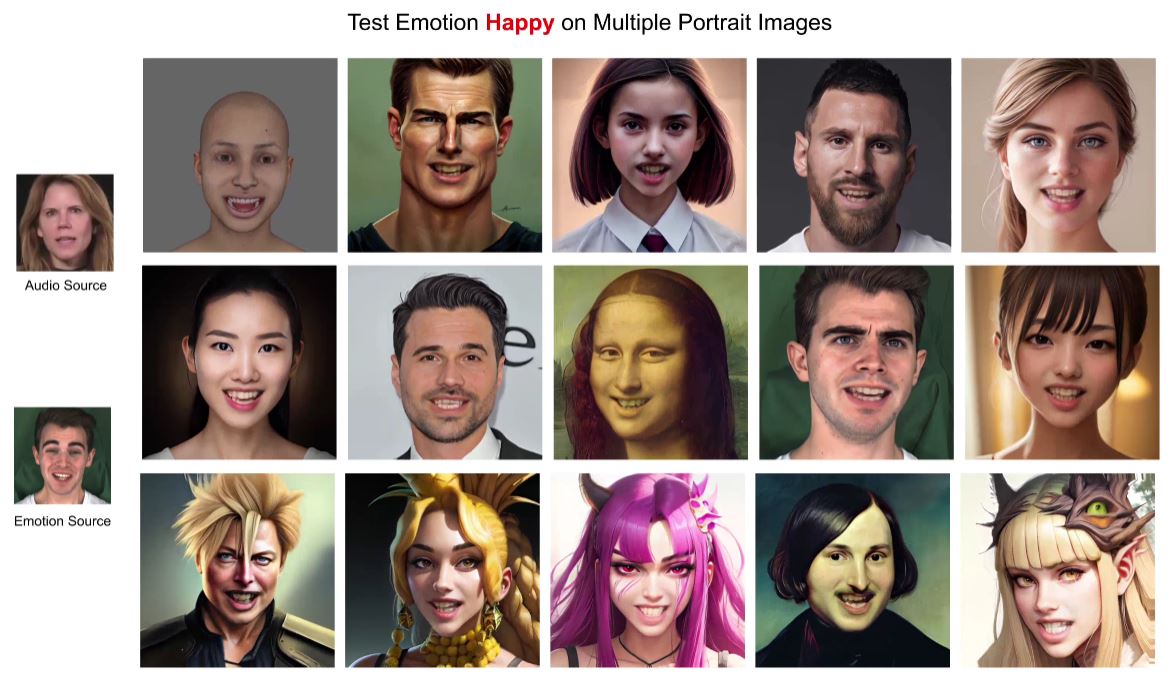

大家可以看看 DREAM-Talk 在真實人臉和AIGC(人工智慧生成)臉部上測試 ” 生氣 ” 和 ” 開心 ” 情緒的結果。這些不同的臉使用的音檔來源和情感來源都是一樣的。

同一個人物使用不同情緒來源和同一音源的差別,分別有生氣、開心、驚喜、難過、鄙視。同一個人物用不同的情緒就能看出比較明顯的差異,譬如每一個情緒的眼睛動作都不太一樣。

你可以把 DREAM-Talk 應用在跨時空的對話上,譬如達文西和他的畫作蒙娜麗莎的虛擬對話(對話內容由 ChatGPT 生成,音檔由第三方 TTS 生成)。影片內達文西主要表達憤怒的情緒,蒙娜麗莎則表達快樂的情緒。

當然 DREAM-Talk 也可以支援多語言使用,影片裡就使用到中文、日文、法文、德文。

不知道大家看完字節跳動和美國德克薩斯州大學達拉斯分校合作的 DREAM-Talk 有什麼想法呢 ? 雖然現在看起來這些應用可能還不太自然,但這目前還只是演示項目,未來隨著更精細的研發不知道會不會變的完全看不出破綻。如果是這樣的話好像也是滿恐怖的, 有可能哪天突然在網路上看到自己的臉講著自己沒說過的話。