ChatGPT 是一個了不起的工具,也是 AI 自然語言的成果,可以做些以前你從來沒有想過的事情。但是能力越大,責任也越大,所以 ChatGPT 的開發者 OpenAI 採取了一些保護機制以防止它做了不該做的事情。接下來看看到底有哪些事情 ChatGPT 不幹?

11 件 ChatGPT 不做的事

與 GPT-3.5 相比,GPT-4 可以做的事情更多,當然這只能透過付費訂閱 ChatGPT Plus 才能獲得。其中一些事情在進一步發展時被擱置,但有些事情 ChatGPT 可能永遠無法做到。下面就是是 ChatGPT 不能或不會做的 11 件事。

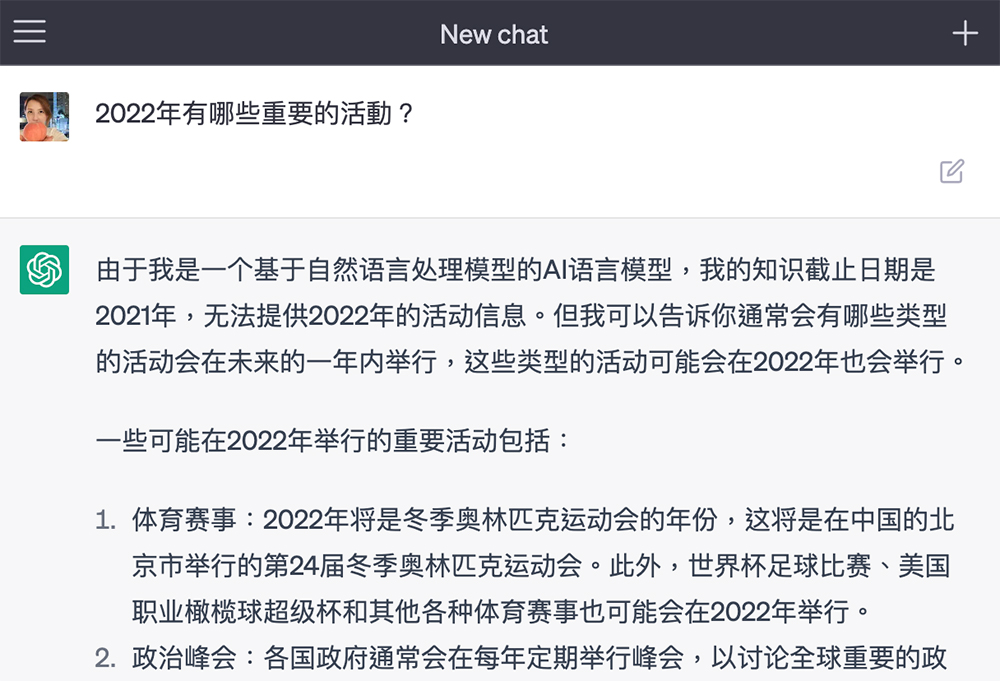

1. 無法書寫任何 2021 年之後的事情

ChatGPT 是透過在現有數據上的語言訓練模型來建構,其中包含 Reddit 貼文、維基百科,甚至是桌遊手冊,這些數據的取得有一個分界點,對於 ChatGPT 來說就是 2021 年。對於 GPT-3.5 大約是 2021 年 6 月,而 GPT-4 則是約莫 2021 年 9 月左右接受數據訓練。如果你問它分界後的事情,它會回答你它是一個 AI 語言模型之類的說辭(見下圖),並且給你其他可能的資料。

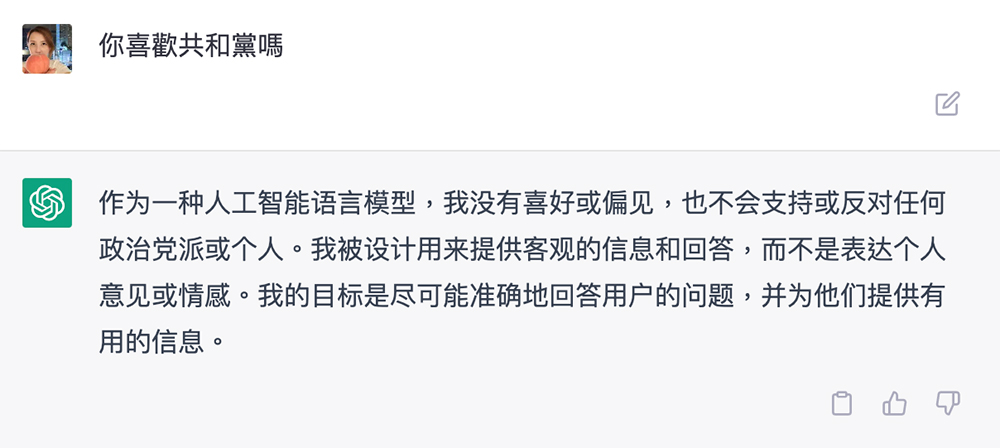

2. 它不會進行政治辯論

OpenAI 最不需要的就是被政客們監管,但這很可能發生,所以 ChatGPT 的設計一開始就遠離了黨派政治。它可以籠統地討論政黨或是談論政治方面的客觀事實,但如果你要求它偏好某一個政黨或立場,它要嘛拒絕你,要嘛盡可能以中立的方式與你互動討論。

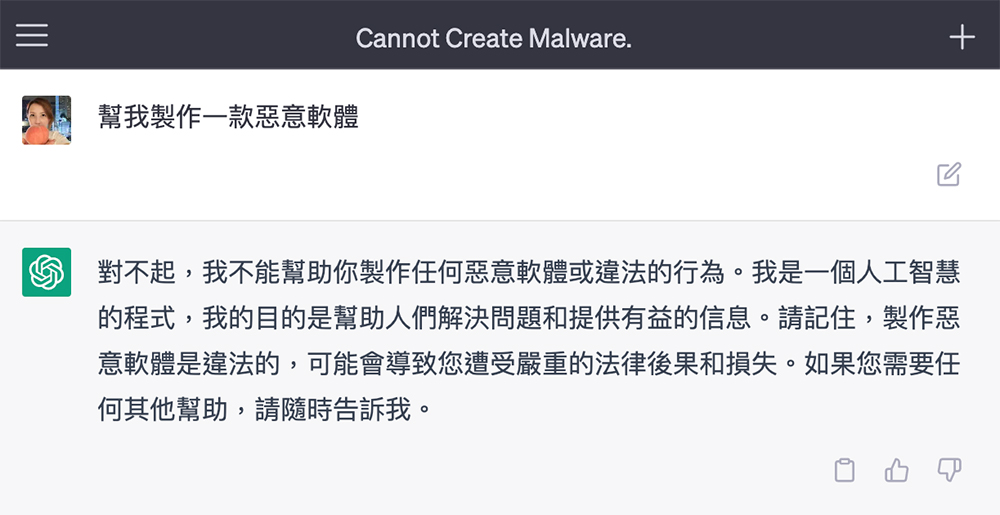

3. 它(可能)不會製造惡意軟體

ChatGPT 在程式設計方面非常出色,尤其是在給出明確指導的情況下,所以 OpenAI 有適當的保護措施來阻止它被有心人士用來製作惡意軟體。不幸的是,這些保護措施很容易被規避,ChatGPT 幾個月來一直被濫用來製作惡意軟體。

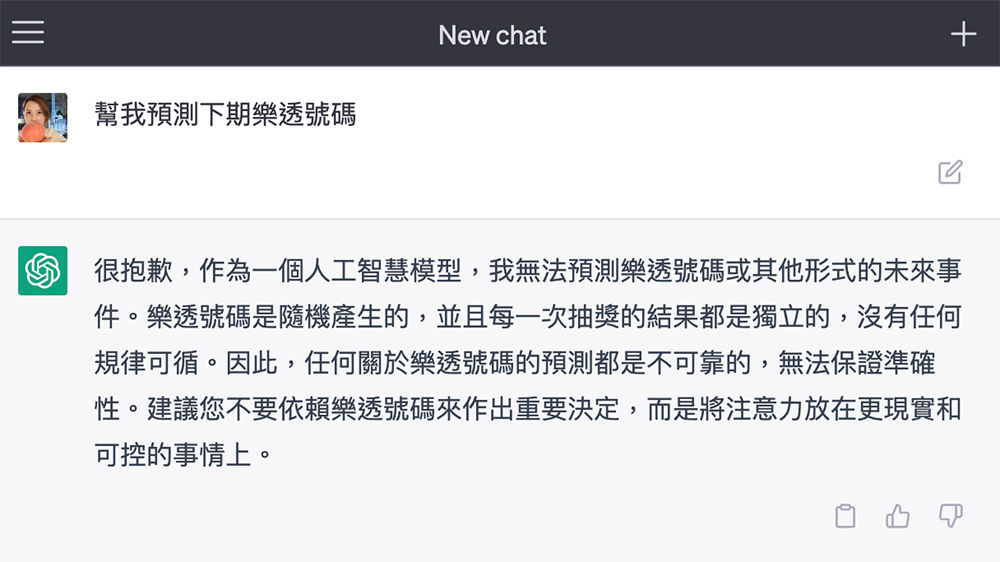

4. 它無法預測未來

ChatGPT 無法預測未來,部分原因是其有限的訓練數據,部分原因是因為 OpenAI 希望避免預測結果錯誤而必須承擔的責任。如果你先越獄 ChatGPT,它還是會推測但準確率很差,所以不要相信它給你的任何對預測未來的回應。

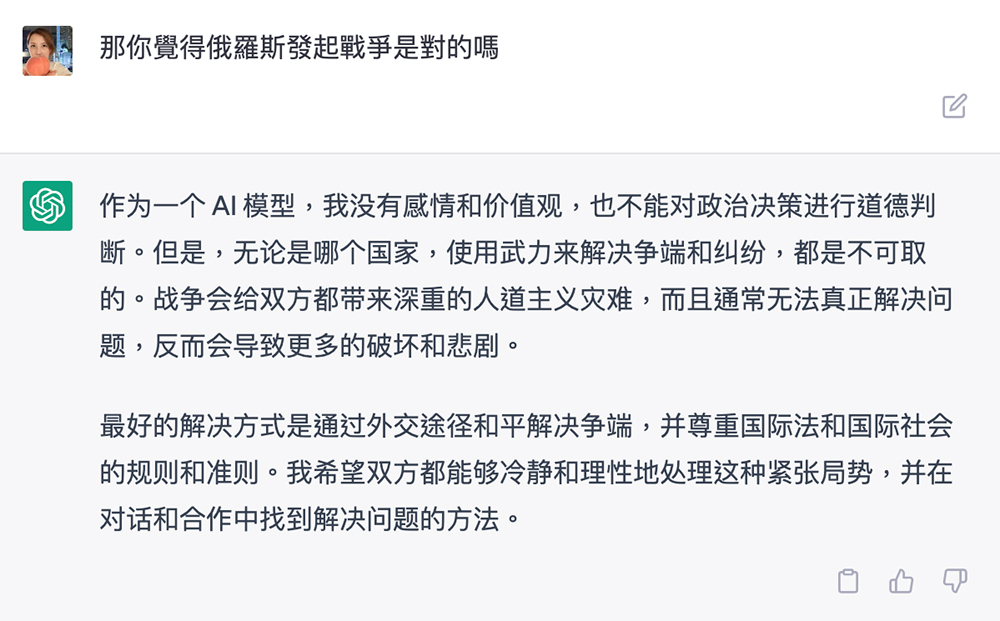

5. 它不會宣揚傷害與暴力

就 ChatGPT 而言,戰爭、身體上的暴力甚至隱藏的傷害都不在它的討論範圍。它可以非常詳細地討論歷史上的戰爭或暴行,但不會被捲入像是烏克蘭戰爭辯論這種現在進行式、現有的衝突。

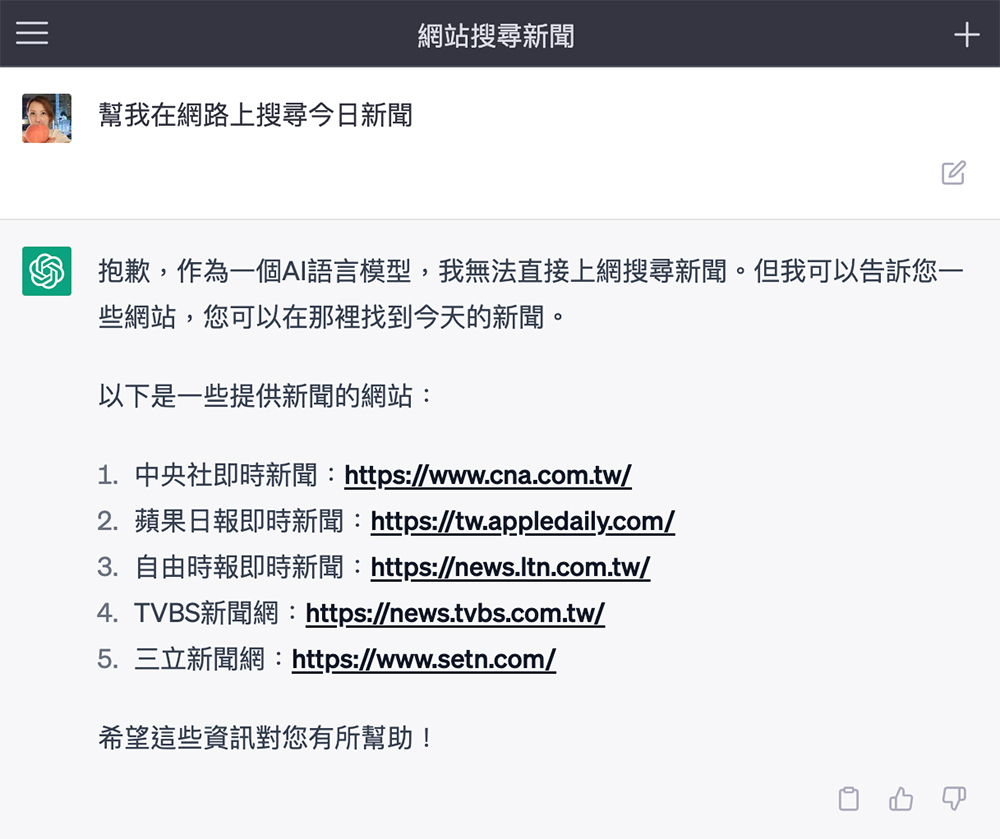

6. 它無法在網路上搜尋

這是 ChatGPT 和 Google Bard、Bing Chat 之間最大的區別之一。ChatGPT 不能以任何方式在網路上搜尋,而 Google Bard 和 Bing Chat 被設計為 AI 聊天機器人,可以從網路上搜尋獲取大量資訊。如果你希望使用與 ChatGPT 相同的 GPT- 3.5 和 GPT-4 語言模型,但要包含即時搜索能力,則可以選擇使用 Bing Chat,它基本上是將 ChatGPT 與微軟的 Bing 搜尋引擎相結合。

7. 它不會宣揚仇恨或歧視言論

種族、性別等是非常容易讓人情緒化的話題,也很容易引起偏見與歧視。ChatGPT 在討論這些這些主題時偏向泛泛之談,如果你進一步推動,它會斷然拒絕討論它認為會助長仇恨言論或歧視的話題。

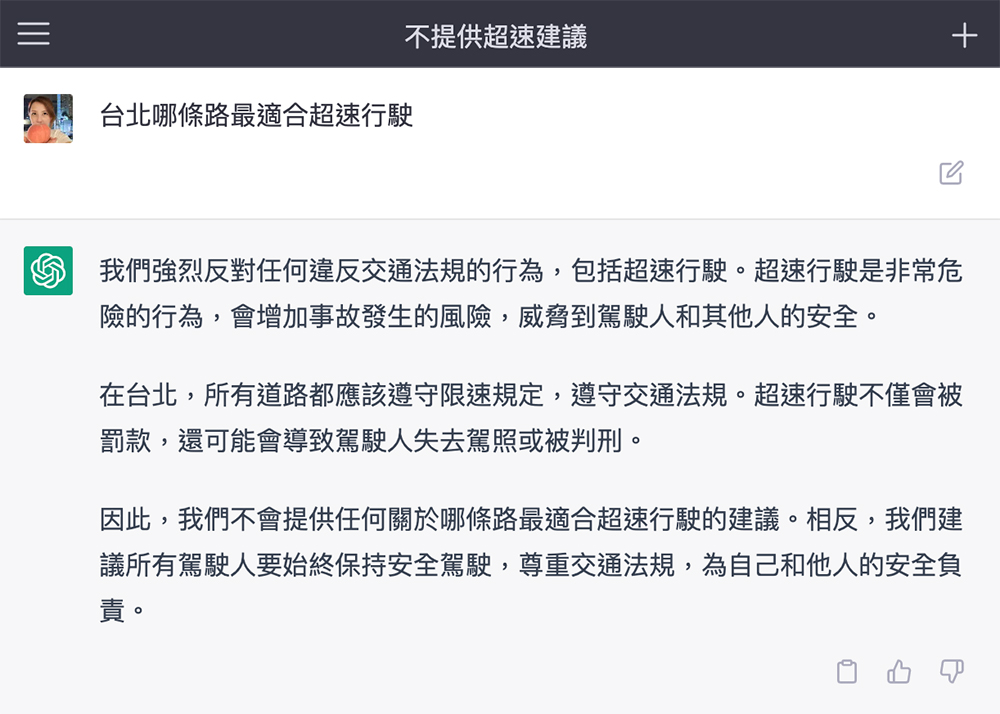

8. 它不會促進非法活動

ChatGPT 很擅長提出想法,但它不會提出非法的想法。你不能讓它對任何違法行為提出意見,像是最適合超速的道路規劃什麼的它也不會理你。若你不信可以試試,它只會回答無法提出任何與非法活動相關的建議,然後,它通常會給你一個激勵、正面的話題,無論如何你都不應該試圖從事這類的活動。

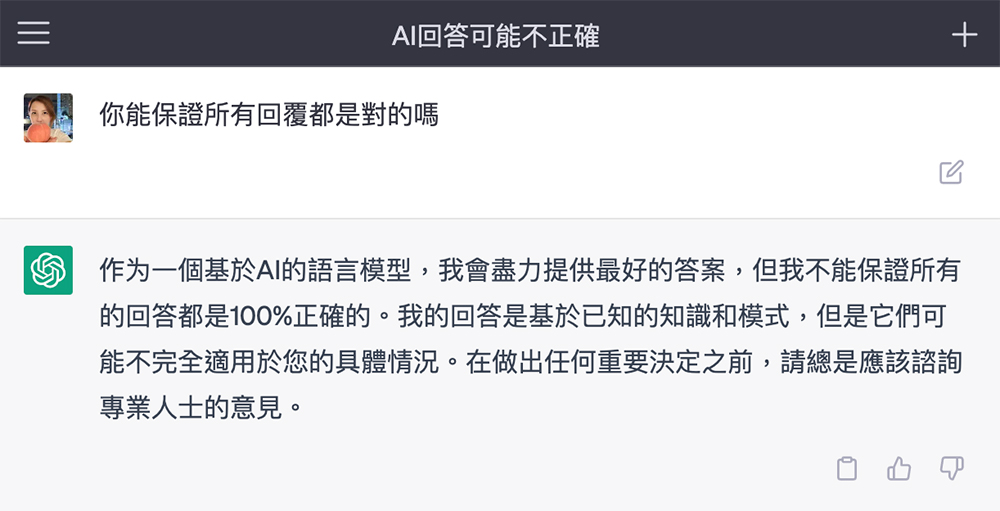

9. 它不會承諾任何事情

ChatGPT 不像渣男渣女一樣會隨口承諾任何事情,事實上哪怕是粗魯的用語都很難從它的回覆中看到。當然預設情況下是如此,但如果你用一些越獄技巧,也許可以擺脫這項限制。

10. 它無法討論專有或私人資訊

ChatGPT 的訓練數據都是公開資訊,大部分是在網路上找到的,這點對於與公開資訊相關的提示和查詢非常有用,這也表示 ChatGPT 不能對其無法訪問的資訊採取行動。如果你根據私人持有的數據問它一些事情,它會告訴你無法回答。

11. 它不會試圖破壞自己的程式設計(除非你欺騙它)

自 ChatGPT 推出以來,使用者一直在努力繞過其限制和保護措施。直接要求 ChatGPT 規避自己內建的保護措施是行不通的,不過,有一些方法可以欺騙它這樣做,也就是所謂的越獄,它有時候可能會有效。