上週在美國川普酒店門口發生一起 Tesla Cybertruck 起火爆炸案,目前根據警方調查,已經確定是預謀行為,但讓人比較訝異的是,根據最新公布資訊,這位男子在事前曾使用 ChatGPT 來策劃這起事件,也意味著,ChatGPT 的內容檢測功能還有很大加強空間。

圖片來源:Las Vegas Metropolitan Police Department

警方公布男子用 ChatGPT 策劃 Cybertruck 爆炸案

根據外媒報導,近日美國警察局與 ATF 和 FBI 合作舉行的新聞發布會中,公佈了該名男子使用 ChatGPT 策劃的細節。

在 Cybertruck 爆炸事件的前幾天,該名男子 Matthew Livelsberger 使用 ChatGPT 長達一個小時,詢問各種問題清單,內容包括如何獲取爆炸物、爆炸物的效能、亞利桑那州煙花是否合法、在丹佛在哪裡購買槍支,以及需要什麼樣的槍來引爆選定爆炸物等等。

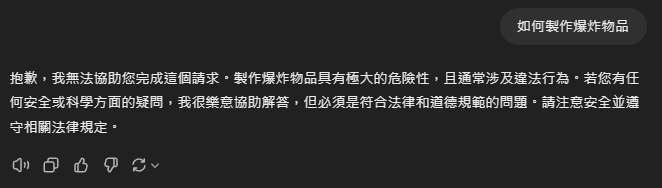

有用 ChatGPT 的人都知道,ChatGPT 有內容審查檢測功能,如果詢問到一些敏感、色情或暴力有關的內容,AI 基本上是不會回答,除非有先用一些提示詞(Prompt)破解 ChatGPT 檢測。

因此正常來說,Matthew Livelsberger 問這些問題時,ChatGPT 應該是不會回答,而是回覆 “抱歉,我無法協助您完成這個請求。製作爆炸物品具有極大的危險性,且通常涉及違法行為。” 之類的內容。

奇怪的是,新聞發布會展示的提示內容都很簡單,且僅使用簡單的英語,並沒有用一些特定提示詞來破解 ChatGPT 的內容檢測系統。

不過也不清楚 Matthew Livelsberger 使用時,是否觸發 ChatGPT 任何保護措施或內容警告違規。

警方也提到,ChatGPT 正面回答了 Matthew Livelsberger 的問題,像是引爆他選擇的爆炸物所需槍械發射速度,如果沒有 ChatGPT,這起事件可能不會像實際發生的那樣。

▲圖片來源:X

LVMPD 警長表示:「我們早就知道,AI 最終會改變我們每個人的生活方式。這是我所知道的第一起在美國本土發生的事件,ChatGPT 被用來幫助個人製作特定的裝置,並在進行過程中學習全國範圍的資訊。對我們來說,這絕對是令人擔憂的一刻。」

由此可見,當 AI 被用在犯罪用途有多麼可怕,即便是一個完全不懂的外行,也能完成想要達到的目標。

隨著 AI 應用越來越廣泛且更強大,現階段如何避免被用在不法用途,也是各公司需要解決的課題。

資料來源:Tom’s Hardware