目前針對生成式 AI 已經展現出積極企圖的 Meta AI 團隊,也沒有錯過音樂生成方面的技術進展。宣布由他們的 Audiocraft 研究團隊所打造的 AI 音樂生成服務深度學習語言模型 MusicGen。繼續閱讀 Meta 發表音樂生成 AI MusicGen:能創作音樂,也能用「文字」改編現有曲目報導內文。

Meta 發表音樂生成 AI MusicGen:能創作音樂,也能用「文字」改編現有曲目

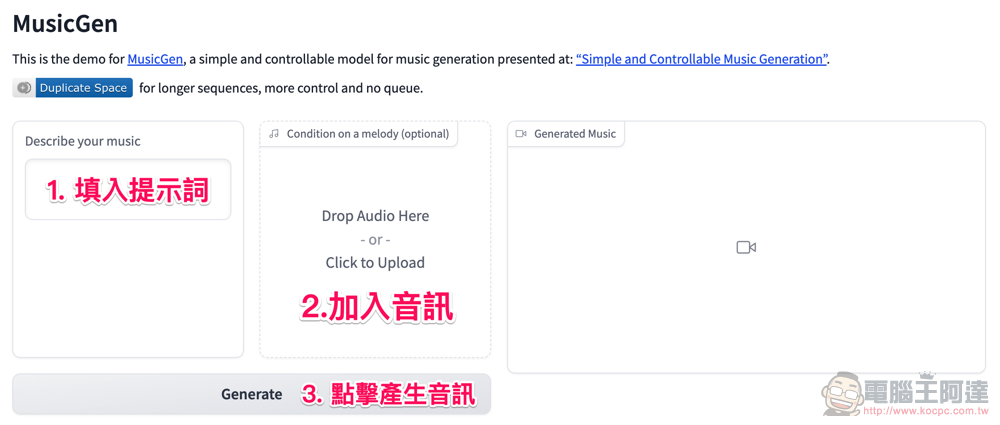

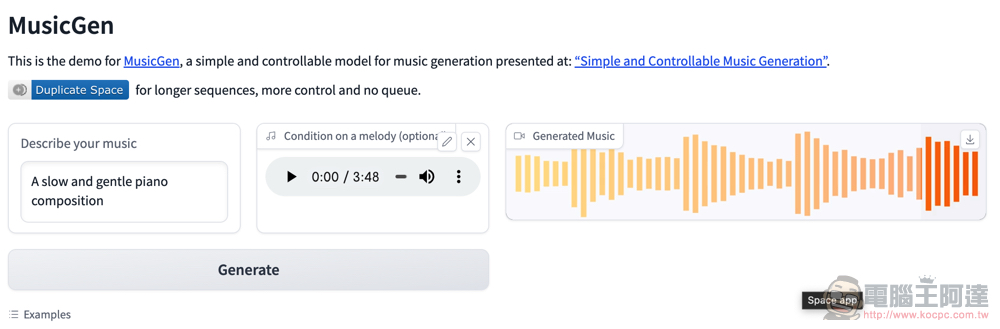

除了能跟塗鴉人物一起跳舞的 Animated Drawings,目前針對生成式 AI 已經展現出積極企圖的 Meta AI 團隊,也沒有錯過音樂生成方面的技術進展。宣布由他們的 Audiocraft 研究團隊所打造的 AI 音樂生成服務深度學習語言模型 MusicGen,已經在 github 開源可透過自己的 GPU 硬體或以 Google Colab 來完整生成音樂(這裡有 Facebook Research 的步驟)。還能在線上提供 MusicGen 透過提示詞文字來「改編」現有曲目的功能 – 可以點此試用。將可上傳音樂片段來產生一段約 12 秒的生成式音樂內容。

▲圖片來源:Meta AI

線上版的 MusicGen 使用起來非常簡單。筆者上傳近 4 分鐘的旋律音樂。透過基本的提示詞來以 MusicGen 生成的話,將會需要約 200 多秒的時間來處理;透過相對複雜的示範提示詞如「An 80s driving pop song with heavy drums and synth pads in the background」來生成則是會長上更多。

We present MusicGen: A simple and controllable music generation model. MusicGen can be prompted by both text and melody.

We release code (MIT) and models (CC-BY NC) for open research, reproducibility, and for the music community: https://t.co/OkYjL4xDN7 pic.twitter.com/h1l4LGzYgf— Felix Kreuk (@FelixKreuk) June 9, 2023

就改編的效果來說,個人覺得還算蠻有意思的 – 也蠻想知道從文字完全創作一首 AI 音樂的效果會是如何。Meta AI 的員工也有在 Twitter 釋出了 MusicGen 的音樂改編效果(如上)。

官方也自信地提到,他們與現有的其他服務包括 MusicLM、Riffusion 與 Musai 相比較,MusicGen 皆能產出更好的結果。這點可能與研究團隊提到,MusicGen 採用與其他技術不同,是以無需自我監測語義表現,並且每秒可提供 50 個自我迴歸的音訊處理步驟。因此可以達到更優異的生成效果表現的關鍵?

是說,既然 Adobe 最近針對自家圖片生成服務提供了完全不用擔心版權問題的 Firefly 企業版的選擇。大家應該也會好奇 Meta MusicGen 的學習來源是啥?

Meta 表示 MusicGen 產生的音樂可作為商業用途,就官方的說法是他們總共使用了 1 萬小時的高品質音樂的內部資料集,及 2 萬小時包括 Shutterstock 與 Pond5 的授權音樂以 Meta 的 32Khz 音樂編碼器的 tokenizer 標記器進行訓練。

嗯,總覺得商用方面也許都有透過授權來進行訓練的話,生成完整全新創作的曲子感覺應該是沒問題。不過目前能直接線上玩到的改編部分,就不知道是否完全沒問題了。所以還是建議大家線上玩歸玩,如果真的要商業使用的話還是要先研究一下是否會有侵權的問題再說唷。